大家好,我是Autoz(

上一篇教程,我们安装了Astrbot,有些人可能承担不起昂贵的AI费用(包括我)

所以,今天来教大家,怎么用Ollama来部署一个全免费的AI

需求剁手

一个搭载至少16g显存(推荐Nvidia显卡)或者16g ddr5(ddr4)的运存的服务器/电脑

🧠(一个有动手能力的脑子(but脑子好像没有手啊))

为什么用ollama呢,因为他兼容性好啊,什么配置都能用,并且还自带超级好用(超级垃圾)的资源调度系统,其实如果你不嫌折腾的话也可以用vllm或sglang,(用p100的最好放弃,安装sd就已经够麻烦了,vllm难如登天,反正我没成功)

其实今天的内容最适合的是windows系统,因为装驱动简单,但是1panel可不支持windows,所以。。。哎生命不息,折腾不止嘛。干他!

我用的是一台装着p100显卡的服务器,装的是580的驱动,cuda13,虽然版本高但是很多东西却能识别为570和cuda12或11,反而比较好

安装NV三件套

用nvidia显卡的要安装三个东西,网上一搜很好找的,所以我就不多赘述了

1.nvidia驱动

2.cuda toolkit

安装完后建议打开1p点开AI一栏,点击GPU监控,如果正常显示了内容,那驱动一定是好的

安装ollama

看完第一期的应该已经有1panel了,没有的建议上网找教程,我的1panel安装讲的并不好,不全面

在1p的应用商店里搜索ollama,点击安装,选择端口外部访问,再选择上开启GPU支持,等待,就安装好了,如果特别慢的话你可以选择老版本试试

安装好ollama上以后,你要配置一下ollama的跨站,不然ollama不能再astrbot里使用

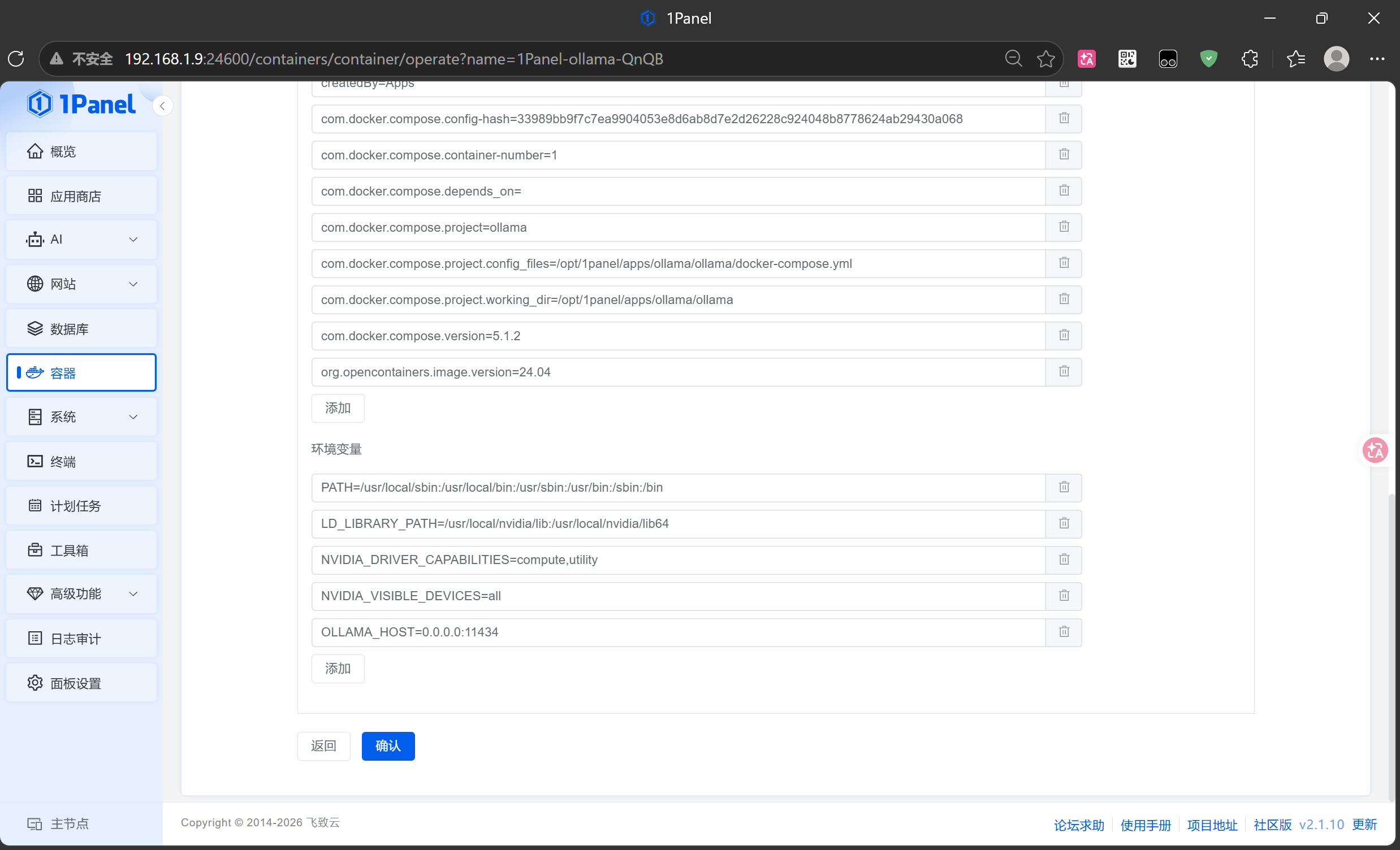

点击容器,找到有ollama字样的,点击编辑

往下滑,找到环境变量&标签,添加一个写:

OLLAMA_HOST=0.0.0.0:11434

点确认,如果没说失败的话就是成功了(bushi

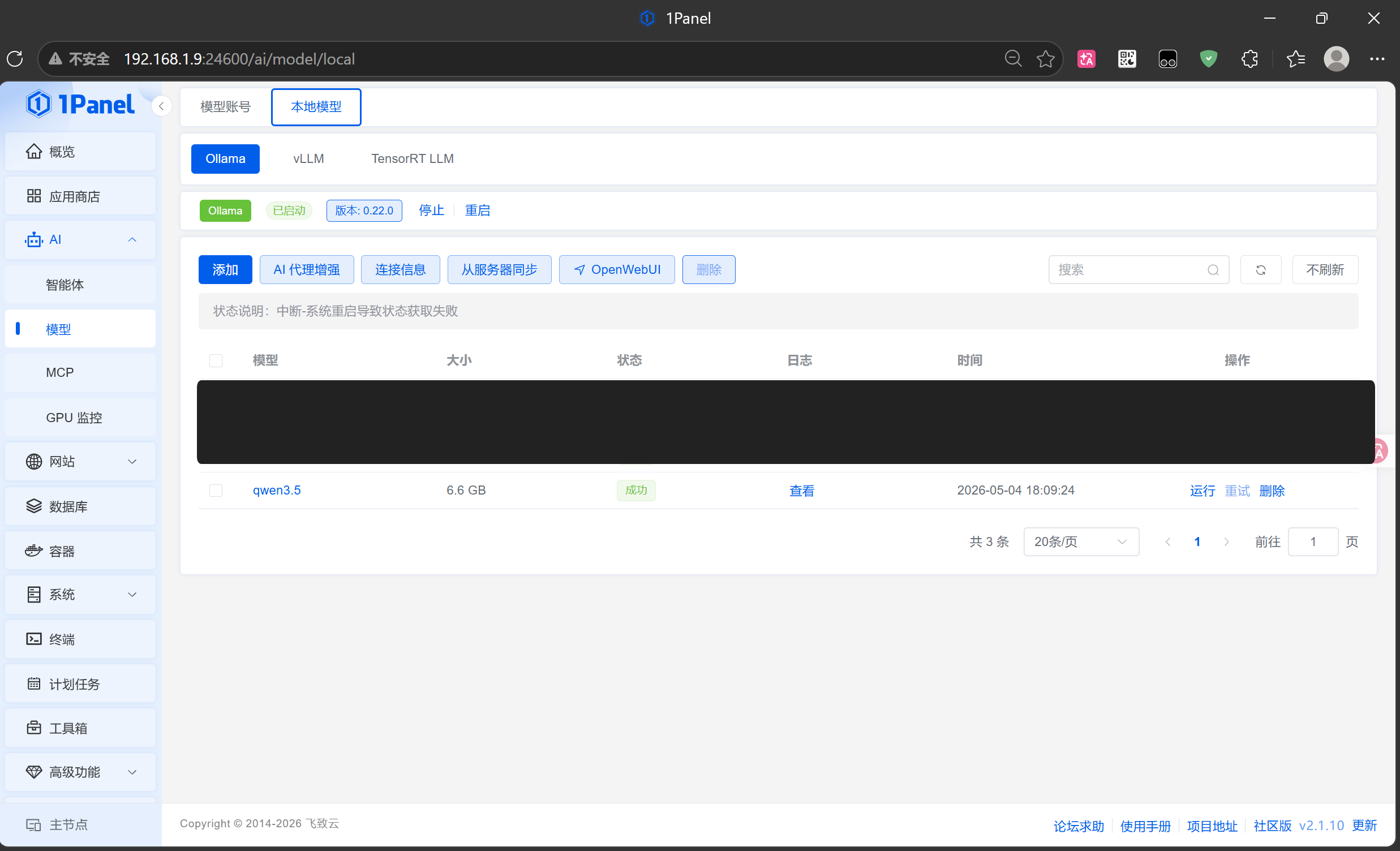

点AI栏,选模型,点本地模型,点到ollama这一栏,如果ollama显示启动的话就成功安装ollama了

下载模型

ollama下载模型只需要在刚才本地模型那一页里点添加,输入一个模型名称点确认就可以开始下载了

推荐使用:

显存<=16G:qwen3.5:8b,qwen3:14b

显存>16G:qwen3.5:27b(这是最佳选择)

提示:一定要在晚上9点之前下载,9点之前下载飞快40mb/s,9点以后就降低到15mb,甚至几kb,大概是外国人上班了,或者是国内的下班下课了

下载成功的话你下载的模型下面就会写成功

如果失败就点一下重试

对了,在你允运行任务时,包括下载模型,下载应用时,千万不要手贱去点工具箱里的缓存清理,不然日志就没了,你的主节点那里的任务永远不结束,但是只要重启一下面板就行了,实在不行就重启服务器

配置astrbot

终于啊,到这一步了

打开astrbot后台点模型提供商,点添加提供商,选择ollama,然后默认配置就可以,如果让你填API Key,你就随便填,ollama不需要api key,然后推荐点一下高级里面的关闭思考,然后点下面的获取模型列表,找到自己的点一下+号就可以了

再见!

下一期napcat与astrbot联动!

评论区